infrastruktura badawcza

Infrastruktura dla zasobów leksykograficznych

W ramach projektu DARIAH.LAB w Instytucie Języka Polskiego PAN powstała infrastruktura badawcza do opracowywania, integracji i udostępniania zasobów leksykograficznych. System łączy metody pracy leksykografów z narzędziami cyfrowymi, umożliwiając pełny cykl życia danych — od pozyskania i przetworzenia do wersji cyfrowej po opracowanie i integrację z zewnętrznymi bazami danych.

O projekcie

Informacje o projekcie

Nazwa projektu:

Cyfrowa infrastruktura badawcza dla humanistyki i nauk o sztuce DARIAH-PL (DARIAH.LAB)

Nr projektu:

POIR.04.02.00-00-D006/20

Kierownik projektu:

mgr inż. Parkoła Tomasz (IJP: dr Krzysztof Nowak)

Finansowanie:

Projekt realizowany w ramach Działania 4.2 Programu Operacyjnego Inteligentny Rozwój 2014–2020

Okres realizacji:

2021-2023

CEL i założenia

Cel projektu

Zasoby leksykograficzne języka polskiego — słowniki, kartoteki materiałowe i korpusy — są obecnie rozproszone zarówno w obrębie poszczególnych instytucji, jak i pomiędzy nimi, co znacząco utrudnia ich łączne przeszukiwanie oraz wykorzystanie w badaniach nad rozwojem i zróżnicowaniem języka. W odpowiedzi na te wyzwania w ramach projektu DARIAH.LAB opracowano infrastrukturę umożliwiającą przetwarzanie, integrację i udostępnianie różnorodnych danych leksykograficznych w ustrukturyzowanej formie. Projekt wpisuje się w nurt współczesnej humanistyki cyfrowej, rozwijając podejścia oparte na pracy z danymi. Celem przedsięwzięcia było stworzenie środowiska, które wspiera zarówno zachowanie i upowszechnienie dziedzictwa polskiej leksykografii, jak i rozwój nowych metod badawczych, opartych na integracji danych, ich semantycznym powiązaniu oraz wykorzystaniu narzędzi automatycznego przetwarzania języka.

Infrastruktura

Infrastruktura badawcza

Infrastruktura obejmuje zestaw narzędzi do przetwarzania tekstu, standardy, modele danych i ontologie, które wspierają opracowanie oraz integrację zasobów leksykograficznych. Tworzy spójne środowisko umożliwiające gromadzenie, przetwarzanie, strukturyzację i udostępnianie danych w ujednoliconej formie.

Pozyskiwanie źródeł

Gromadzenie i przygotowanie materiałów źródłowych.

Rozpoznawanie tekstu

Rozpoznawanie tekstu ze skanów z przy użyciu technologii OCR i HTR.

Konwersja

danych

Konwersja danych do ustrukturyzowanego formatu TEI XML.

Anotacja i strukturyzacja

Oznaczanie i porządkowanie danych, anotacja tekstu.

Prezentacja

danych

Prezentacja i udostępnianie danych w środowisku cyfrowym.

Zastosowane rozwiązania umożliwiają realizację kolejnych etapów pracy z danymi leksykograficznymi, zapewniając ich spójność, interoperacyjność oraz gotowość do dalszego wykorzystania w badaniach.

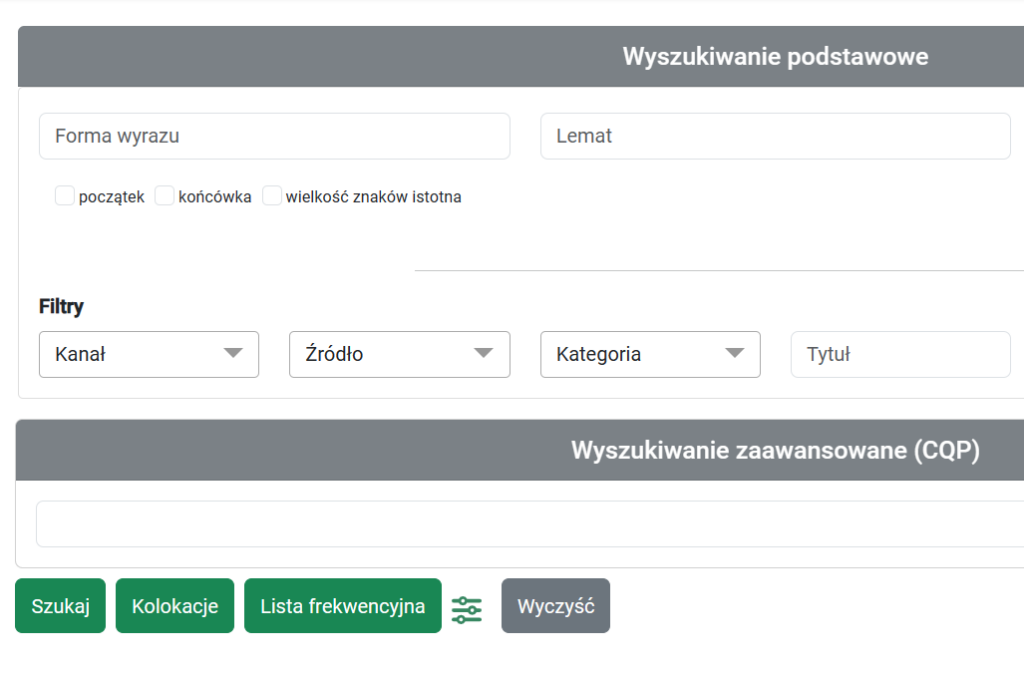

Baza Leksyki Polskiej PoliLex: środowisko pracy z danymi leksykograficznymi

Baza Leksyki Polskiej została przygotowana jako środowisko dla danych leksykograficznych, umożliwiające ich gromadzenie, opracowywanie i udostępnianie. Jej struktura i funkcjonalności rozwijano oraz dostosowywano w toku pracy z materiałami Instytutu Języka Polskiego PAN, co pozwoliło na wypracowanie rozwiązań odpowiadających specyfice tego typu zasobów. System wspiera spójne zarządzanie danymi oraz ich wykorzystanie w badaniach językoznawczych. Opracowane rozwiązania umożliwiają digitalizację, segmentację i anotację danych leksykograficznych, ich integrację w postaci ustrukturyzowanych plików XML zgodnych ze standardem TEI, a także udostępnianie w formie przeszukiwalnej i semantycznie powiązanej.

Standardy danych

W procesie opracowania danych leksykograficznych wykorzystywane są ustandaryzowane formaty i języki opisu, które zapewniają ich spójność, interoperacyjność oraz możliwość integracji w środowisku cyfrowym. Zastosowane standardy umożliwiają strukturyzację danych, ich walidację oraz zachowanie jednolitego sposobu zapisu, co stanowi podstawę dalszego przetwarzania, analizy i udostępniania zasobów.

Schematron

język walidacji XML do definiowania reguł i kontroli poprawności struktury danych

SPARQL

standard języka zapytań umożliwiający wyszukiwanie i analizę danych zapisanych w modelu semantycznym (RDF)

WordPress

system zarządzania treścią wykorzystywany do tworzenia i utrzymania serwisu internetowego projektu

Narzędzia wykorzystywane w procesie przetwarzania danych

W kolejnych etapach opracowania danych leksykograficznych wykorzystywany jest zestaw wyspecjalizowanych narzędzi wspierających ich przetwarzanie — od rozpoznawania tekstu, przez jego strukturyzację i anotację, po przygotowanie do publikacji i integracji.

Label Studio

środowisko do anotacji danych i przygotowania zbiorów uczących dla modeli językowych

Prodigy

środowisko do anotacji danych i przygotowania zbiorów uczących dla modeli językowych

TEI Publisher

środowisko do publikacji i prezentacji danych w standardzie TEI, umożliwiające ich przeszukiwanie i udostępnianie w formie aplikacji webowej.

WordPress

system zarządzania treścią wykorzystywany do tworzenia i utrzymania serwisu internetowego projektu

Modele danych i ontologie

Modele danych i ontologie definiują schematy oraz relacje semantyczne między elementami zasobów leksykograficznych, umożliwiając ich spójne opisywanie, integrację i semantyczne przetwarzanie w środowisku cyfrowym.

LexInfo

ontologia opisująca kategorie i właściwości leksykalne w modelach danych językowych

model_turtle

reprezentacja modelu danych w formacie Turtle wykorzystywanym w Linked Data

REALIZACJA

Przebieg prac i rozwój infrastruktury

Prace nad opracowaniem zasobów leksykograficznych realizowane były etapowo — początkowo w ramach projektu DARIAH.LAB, a następnie w oparciu o wypracowaną infrastrukturę, rozwijaną w dalszych działaniach badawczych.

FAZA I: Projekt DARIAH.LAB (2021–2023)

Pierwszy etap projektu koncentrował się na przygotowaniu zaplecza technicznego oraz wypracowaniu procesu przetwarzania danych leksykograficznych. Kluczowe działania obejmowały rozwój metod rozpoznawania pisma odręcznego i druku oraz opis struktury danych, co pozwoliło na przygotowanie ustrukturyzowanych zasobów wykorzystywanych w procesie tworzenia i testowania infrastruktury. Równolegle opracowano metody segmentacji i anotacji danych, umożliwiające wyodrębnienie elementów struktury artykułów hasłowych oraz ich dalsze przetwarzanie. Rezultatem fazy I były wstępnie ucyfrowione i częściowo ustrukturyzowane zasoby zapisane w formacie XML, które stanowiły podstawę doskonalenia narzędzi automatycznego rozpoznawania i analizy tekstu.

FAZA II: Badania statutowe IJP PAN (od 2024-)

Drugi etap koncentruje się na pogłębionym opracowaniu danych oraz ich wykorzystaniu w środowisku cyfrowym. Prace obejmują porządkowanie i ujednolicanie zapisów, a także doprecyzowanie struktury i opisu danych. Istotnym kierunkiem działań jest również udostępnianie zasobów w formie umożliwiającej ich wygodne przeszukiwanie i analizę, w tym zestawianie danych z materiałami źródłowymi. Równolegle prowadzone są działania związane z ich dalszą formalizacją i integracją, które pozwalają na łączenie danych z innymi zasobami.

ZESPÓŁ

Zespół projektowy

Dziękujemy wszystkim osobom zaangażowanym w prowadzone prace.

Krzysztof Nowak (kierownik IJP PAN)

Dorota Mika (koordynator IJP PAN)

Wojciech Łukasik

Ewa Rodek

Maria Bugajska

Iwona Krawczyk

Małgorzata Czachor

Michaił Osłon

Magdalena Majdak

Dorota Adamiec

Renata Bronikowska

Katarzyna Kryńska

Paweł Kupiszewski

Olga Chymkowska

Wiesław Morawski

Halina Hurowska

Jan Idziak

Piotr Giedziun

Albert Leśniak

Bartłomiej Borek